Teams, die KI-Features in Produktion bringen, vertrauen auf uns

In wenigen Minuten angebunden

Ein API-Key. Volle Transparenz über OpenAI.

Binden Sie Ihre OpenAI-Organisation mit einem Read-only-Admin-Key an. DoiT erfasst Nutzung, Token-Zahlen auf Modellebene und Rechnungsdaten automatisch – ohne Proxies, ohne SDK-Anpassungen, ohne manuelle CSV-Exporte. Schon wenige Stunden nach der Anbindung steht Ihnen ein einheitliches Reporting zur Verfügung.

Das bekommen Sie

Gemacht für den Alltag mit OpenAI

Genau die Punkte, die FinOps- und Engineering-Verantwortliche bei uns ansprechen, sobald sie ihre OpenAI-Organisation anbinden.

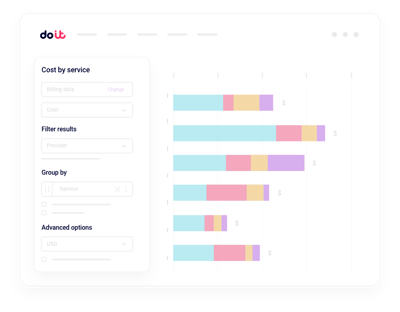

Einheitliches Usage-Reporting

Schlüsseln Sie OpenAI-Ausgaben nach Projekt, API-Key, Modell oder Team auf – ganz ohne eigene Token-Zähler.

Anomalien in Echtzeit

Alerts zu Token-Spitzen und außer Kontrolle geratenen Prompts – in Minuten statt Stunden.

Modellmix optimieren

Erkennen Sie Prompts, die an GPT-4 gehen, aber auch auf einem günstigeren Modell ohne Qualitätsverlust laufen würden.

Input- vs. Output-Tokens

Kosten aufgeschlüsselt nach Input-, Cached- und Output-Tokens über alle Modelle hinweg.

Zuordnung auf Feature-Ebene

Ordnen Sie Token-Ausgaben dem Produkt-Feature oder Kunden zu, die sie verursachen – nicht nur dem API-Key, der sie aufgerufen hat.

Budgets und Guardrails

Setzen Sie Budgets pro Projekt und Team, damit außer Kontrolle geratene Agents im nächsten Monat keine bösen Überraschungen im Finance-Team auslösen.

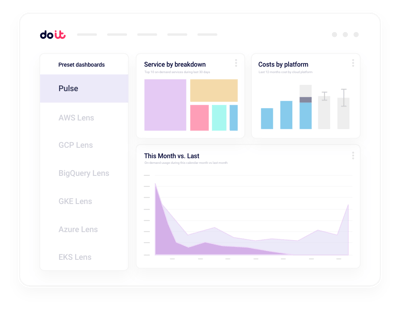

Das native Usage-Dashboard zeigt, was passiert ist. Cloud Intelligence™ hilft Ihnen, daraus Konsequenzen zu ziehen.

Mehr als die OpenAI-Usage-Seite

Projektübergreifende Rollups

Konsolidierte Sicht über alle OpenAI-Projekte und -Organisationen, mit Drilldown bis auf jeden Key und jedes Modell.

Echtzeit-Alerts bei Anomalien

Machine-Learning-Erkennung auf Modell-, Projekt- und Key-Ebene – ausgeliefert direkt in Slack oder per E-Mail.

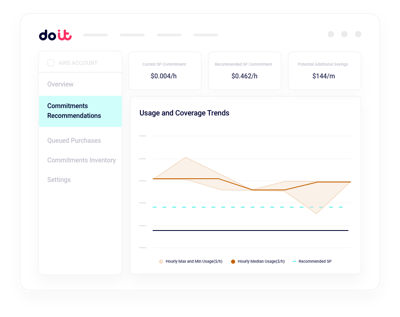

Forecasts für Modellkosten

Projizieren Sie den Token-Verbrauch auf Ihr Produktwachstum, bevor ein neues Feature in GA geht.

Saubere Tags und Allocation

Mappen Sie API-Keys auf Produkte, Kunden und Kostenstellen und verteilen Sie gemeinsam genutzte Ressourcen so, wie Finance es erwartet.

Multicloud-KI-Attribution

Kombinieren Sie OpenAI-Ausgaben mit Bedrock, Vertex und Azure OpenAI – und sehen Sie Ihre komplette KI-Rechnung an einem Ort.

Forward Deployed Engineers

Erstklassige Cloud-Architekten, die als Erweiterung Ihres Teams Optimierungen umsetzen.

Schnell wachsende Unternehmen setzen auf DoiT Cloud Intelligence™

Ø Einsparung in den ersten 90 Tagen

Ø Implementierungsdauer

“Die Zuverlässigkeit von DoiT in Kombination mit der Flexibilität des Systems erlaubt uns, unsere Amazon-EKS-Workloads sicher zu optimieren – ganz ohne Zutun unserer Engineers.”

Oren Ashkenazy

Director of DevOps and Cloud bei Fiverr

Bereit, Ihre OpenAI-Organisation anzubinden?

Bringen Sie Ihre Token-Kosten unter Kontrolle.

Frequently asked

questions

Wie bekomme ich Transparenz über OpenAI-Kosten in mehreren Projekten und Keys?

Binden Sie Ihre OpenAI-Organisation einmalig mit einem Admin-Key an. Cloud Intelligence™ erfasst die Nutzung jedes Projekts und jedes API-Keys – so lassen sich Token-Ausgaben nach Projekt, Modell, Key oder Team in einer einzigen Ansicht aufschlüsseln. Keine eigenen Zähler, keine manuellen CSV-Exporte.

Wie integriere ich OpenAI-Nutzungsdaten am besten in Cloud Intelligence™?

Nutzen Sie einen Read-only-Admin-Key, der auf Ihre OpenAI-Organisation beschränkt ist. DoiT übernimmt Ingestion, Normalisierung und tagesgenaues Reporting von Input-, Output- und Cached-Tokens je Modell. Die meisten Teams sind innerhalb eines Tages live.

Wie sehe ich, welche Modelle oder Features den Großteil meiner Token-Ausgaben verursachen?

Usage-Reports erlauben den Drilldown von den Gesamtausgaben bis auf ein bestimmtes Modell, Projekt oder einen API-Key. Sobald die Keys gemappt sind, filtern Sie nach Feature, Kunde oder Environment – ganz ohne SQL.

Wie überwache ich OpenAI-Kostenanomalien in Echtzeit?

Die Anomalie-Erkennung läuft kontinuierlich über Modelle, Projekte und Keys. Sobald die Token-Nutzung von der Baseline abweicht – ein Agent in der Endlosschleife, ein fehlerhafter Prompt, ein viral gegangenes Feature – erhalten Sie einen Slack- oder E-Mail-Alert inklusive wahrscheinlicher Ursache.

Kann ich für OpenAI Budgets pro Team oder Produkt-Feature setzen?

Ja. Definieren Sie Budgets und Schwellenwerte pro Projekt, Key oder getaggtem Feature und erhalten Sie gestaffelte Alerts, sobald sich die Ausgaben dem Limit nähern – damit ein außer Kontrolle geratener Agent nicht zur bösen Überraschung am Monatsende wird.

Kann ich OpenAI-Ausgaben mit anderen KI-Anbietern zusammenführen?

Cloud Intelligence™ führt OpenAI, Azure OpenAI, Amazon Bedrock, Google Vertex AI und Anthropic in einem Report zusammen. So vergleichen Sie Token-Ökonomie und KI-Gesamtkosten je Feature oder Kunde.

Was unterscheidet Cloud Intelligence™ vom nativen OpenAI-Usage-Dashboard?

Das OpenAI-Dashboard ist ein reiner Usage-Viewer. Cloud Intelligence™ ist eine Plattform: anbieterübergreifende KI-Transparenz, proaktive Empfehlungen, Echtzeit-Anomalie-Erkennung, Budgets und Governance – plus Zugriff auf Forward Deployed Engineers, die aus den Erkenntnissen konkrete Maßnahmen machen.

Sind meine Daten sicher, wenn ich meine OpenAI-Organisation anbinde?

Cloud Intelligence™ nutzt einen Read-only-Admin-Key nach dem Least-Privilege-Prinzip. Wir erfassen ausschließlich Nutzungs- und Abrechnungs-Metadaten – niemals Prompt- oder Completion-Inhalte. Die Plattform ist SOC 2 Type II zertifiziert.