La scelta dei data team che usano Databricks su larga scala

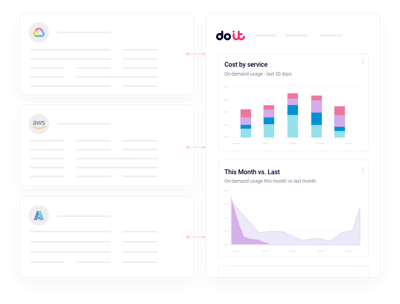

Si collega in pochi minuti

Un solo token. Visibilità totale su Databricks.

Colleghi ogni workspace Databricks tramite un service principal o un access token e indichi a DoiT le Sue system table. Acquisiamo automaticamente consumo di DBU, esecuzioni dei job e metadati dei cluster, incrociandoli con la Sua fattura cloud AWS o Azure — senza exporter e senza pipeline di warehouse da gestire.

Cosa include

Pensato per chi lavora davvero su Databricks

Le funzionalità che i responsabili dei dati e del FinOps ci chiedono quando collegano i loro workspace Databricks.

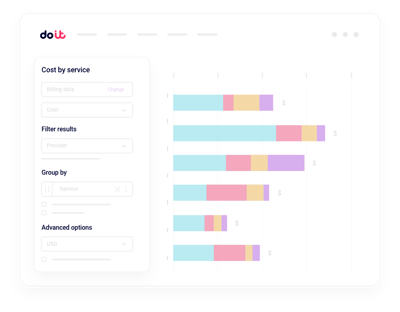

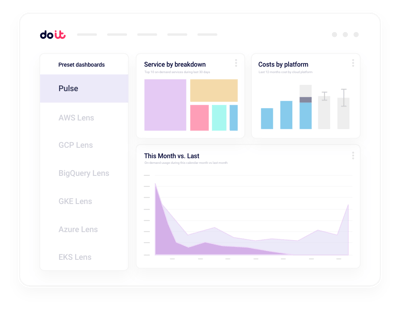

Reporting unificato su DBU e cloud

Analizzi la spesa per workspace, cluster, job o tag e veda i DBU insieme a compute e storage sottostanti in un unico report.

Anomalie in tempo reale

Avvisi su picchi di DBU e job fuori controllo in pochi minuti, non ore.

Right-sizing dei cluster

Individui cluster all-purpose e job sovradimensionati con indicazioni concrete su istanze e autoscaling.

Attribuzione di job e notebook

Attribuisca i DBU al job, alla pipeline o all'utente che li ha generati.

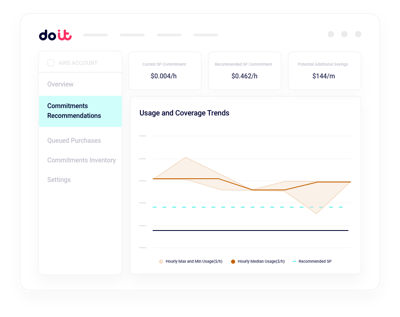

TCO: serverless vs classic

Confronti fianco a fianco serverless SQL, DLT e classic compute per capire dove collocare davvero ogni workload.

Governance e budget

Imposti budget di DBU per team o workspace e intercetti gli scostamenti prima che lo faccia il finance.

Le system table raccontano cosa è stato eseguito. Cloud Intelligence™ La aiuta a intervenire.

Oltre le system table di Databricks

Rollup multi-workspace

Viste consolidate su tutti i workspace e gli account Databricks, con drilldown fino al singolo cluster o job.

Avvisi di anomalie in tempo reale

Rilevamento basato su machine learning su workspace, cluster e job, con notifiche su Slack o email.

Pianificazione dei commitment DBU

Simuli i tier di commit Databricks e i Savings Plans cloud rispetto all'utilizzo reale prima di firmare un contratto.

Tag e allocazioni sotto controllo

Individui i cluster senza tag, applichi regole di allocazione e ripartisca i DBU condivisi come si aspetta il finance.

Allocazione dei costi per job

Suddivida la spesa DBU per pipeline, notebook e utente senza costruirSi un sistema di lineage interno.

Forward Deployed Engineers

Cloud architect di primo livello che lavorano come estensione del Suo team per mettere in pratica le ottimizzazioni.

Le aziende in rapida crescita scelgono DoiT Cloud Intelligence™

Risparmio medio nei primi 90 giorni

Tempo medio di implementazione

“L'attenzione di DoiT all'affidabilità, unita alla flessibilità della piattaforma, ci consente di ottimizzare in piena sicurezza i nostri workloads Amazon EKS senza alcun intervento dei nostri Engineers.”

Oren Ashkenazy

Director of DevOps and Cloud di Fiverr

Pronto a collegare i Suoi workspace Databricks?

DBU e spesa cloud in un'unica schermata.

Frequently asked

questions

Come posso avere visibilità sui costi di Databricks su più workspace?

Colleghi ogni workspace una sola volta tramite un service principal. Cloud Intelligence™ acquisisce i dati di consumo dalle system table di Databricks e li unisce alla Sua fattura cloud: potrà analizzare DBU, job e cluster per workspace, team o tag da un'unica vista.

Qual è il modo migliore per integrare i dati di fatturazione Databricks con Cloud Intelligence™?

Conceda l'accesso in sola lettura allo schema system.billing e colleghi l'account AWS o Azure sottostante. DoiT si occupa di ingestion, normalizzazione e reporting orario. La maggior parte dei team è operativa entro un giorno.

Posso vedere quali job, notebook o utenti generano la maggior parte della spesa DBU?

Sì. Può passare dai totali per workspace fino al singolo job run, pipeline DLT, SQL warehouse o utente. Filtri per tag di cluster, workspace o tipo di compute senza dover scrivere query SQL sulle system table.

Come posso monitorare le anomalie di costo su Databricks in tempo reale?

Il rilevamento delle anomalie è attivo in modo continuo su workspace, cluster e job. Quando il consumo di DBU va fuori scala, riceve un avviso su Slack o via email con la probabile causa, prima che lo sforamento finisca in fattura.

Che differenza c'è rispetto alle dashboard di utilizzo e alle system table di Databricks?

Le system table forniscono dati grezzi di consumo. Cloud Intelligence™ li trasforma in una piattaforma: reporting unificato di DBU e infrastruttura cloud, right-sizing proattivo, rilevamento delle anomalie in tempo reale, budget e logiche di allocazione di cui si possono fidare tanto il finance quanto l'engineering.

Posso confrontare i costi del compute serverless e di quello classic?

Sì. I report mettono a confronto fianco a fianco serverless SQL, DLT, model serving e cluster classic all-purpose e job, incluso il costo dell'istanza cloud sottostante: così potrà decidere dove collocare ciascun workload.

Funziona con Databricks su AWS, Azure e GCP?

Sì. Cloud Intelligence™ supporta Databricks su tutti e tre gli hyperscaler e correla il consumo di DBU con la corrispondente fattura AWS, Azure o Google Cloud, per un total cost of ownership reale.

I miei dati sono al sicuro quando collego Databricks?

Cloud Intelligence™ utilizza credenziali in sola lettura con il principio del privilegio minimo su workspace e system table. Non modifichiamo mai job, cluster o dati, e la piattaforma è certificata SOC 2 Type II.